As câmeras do Centro de Operações do Rio (COR) na Lapa, bairro boêmio do centro do Rio de Janeiro, passarão a fazer parte do sistema de videomonitoramento urbano com reconhecimento facial da Polícia Militar do Estado do Rio de Janeiro. Até o momento, o recurso está disponível em 13 das 21 câmeras na região.

A Secretaria de Estado de Polícia Militar divulgou nesta sexta-feira (19) que firmou uma parceria com a Prefeitura do Rio de Janeiro para ter acesso às 21 câmeras do Centro de Operações do Rio (COR) instaladas no bairro.

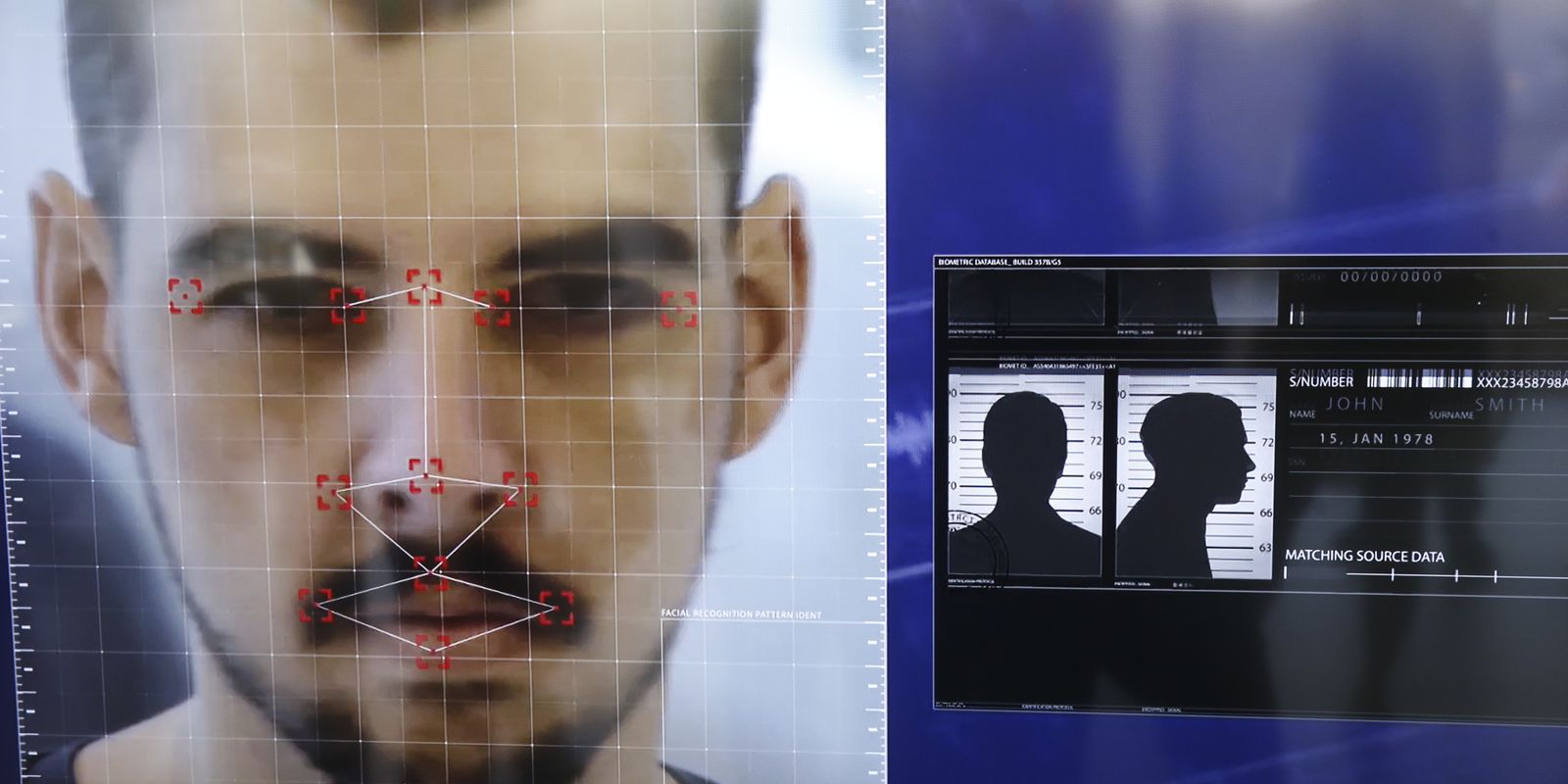

A secretaria explica que, ao ser localizado no sistema de reconhecimento facial, um alerta é enviado para a equipe policial mais próxima da pessoa, que será abordada e presa em caso de confirmação de sua identidade e possíveis pendências judiciais.

O sistema de videomonitoramento da Polícia Militar do Rio de Janeiro foi iniciado no réveillon de 2023, visando o aumento da sensação de segurança da população. O investimento do Governo do Estado no sistema foi de R$ 18 milhões, entre equipamentos e softwares.

Banco de mandados

As imagens captadas são processadas por um software que faz a checagem em um banco de mandados e envia alertas para os policiais que estão na rua. Essa tecnologia levou a prisões no réveillon do Rio, mas também causou a detenção de pessoas por engano. Duas pessoas foram presas e depois soltas porque não havia mandado de prisão em aberto contra elas, no banco de dados da Justiça.

Na época, a secretaria se posicionou sobre essas prisões afirmando que “as inconsistências do sistema podem ocorrer, por uma questão de atualização dos bancos de dados. E é por isso que a Secretaria de segurança pública está trabalhando para unificar e integrar estes bancos de dados (polícia, justiça e governo federal) para dar o máximo de automação a este processo e consequentemente mais rapidez nas abordagens”.

Em entrevista à Rádio Nacional do Rio de Janeiro, o coordenador do Panóptico, projeto do Centro de Estudos de Segurança e Cidadania, Pablo Nunes, disse ver com preocupação o uso dessa tecnologia na Segurança Pública.

“Essas câmeras possuem algoritmos que fazem a identificação e o reconhecimento das faces humanas e já tem farta documentação, nacional e internacional, demonstrando que eles erram muito, principalmente com pessoas negras. E, mais especificamente, com mulheres negras, e é um nível de erro de mais de 30% pra mulheres negras, enquanto que pra homens brancos é menos de 1%, mostrando, exatamente, que há um viés racial muito forte também de gênero,” disse.